排序

论文解释:Vision Transformers和CNN看到的特征是相同的吗?

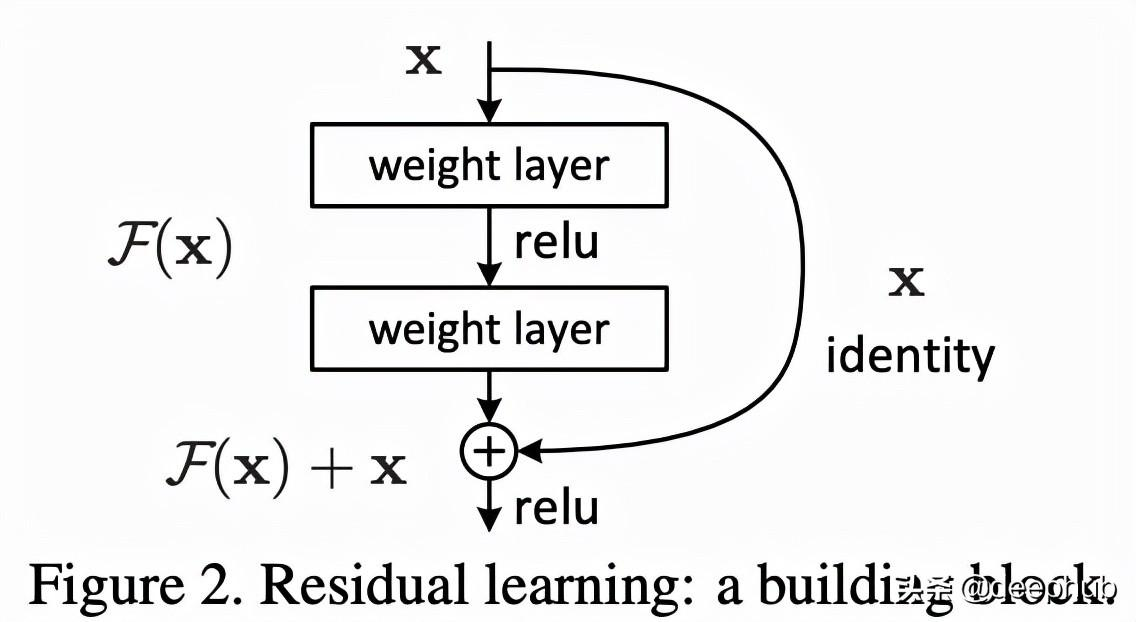

近年来,Vision Transformer (ViT) 势头强劲。 本文将解释论文《Do Vision Transformers See Like Convolutional Neural Networks?》 (Raghu et al., 2021) 由 Google Research 和 Google Brain...

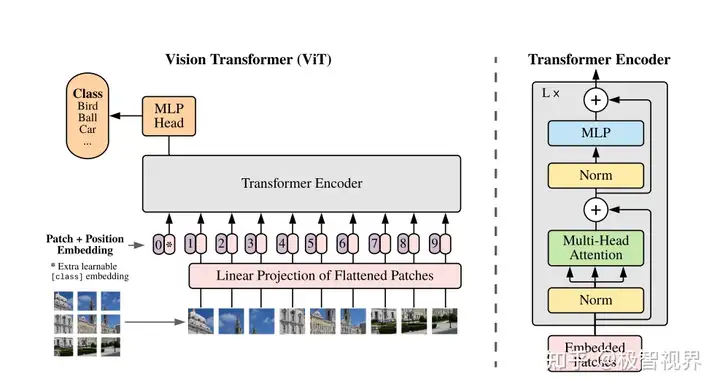

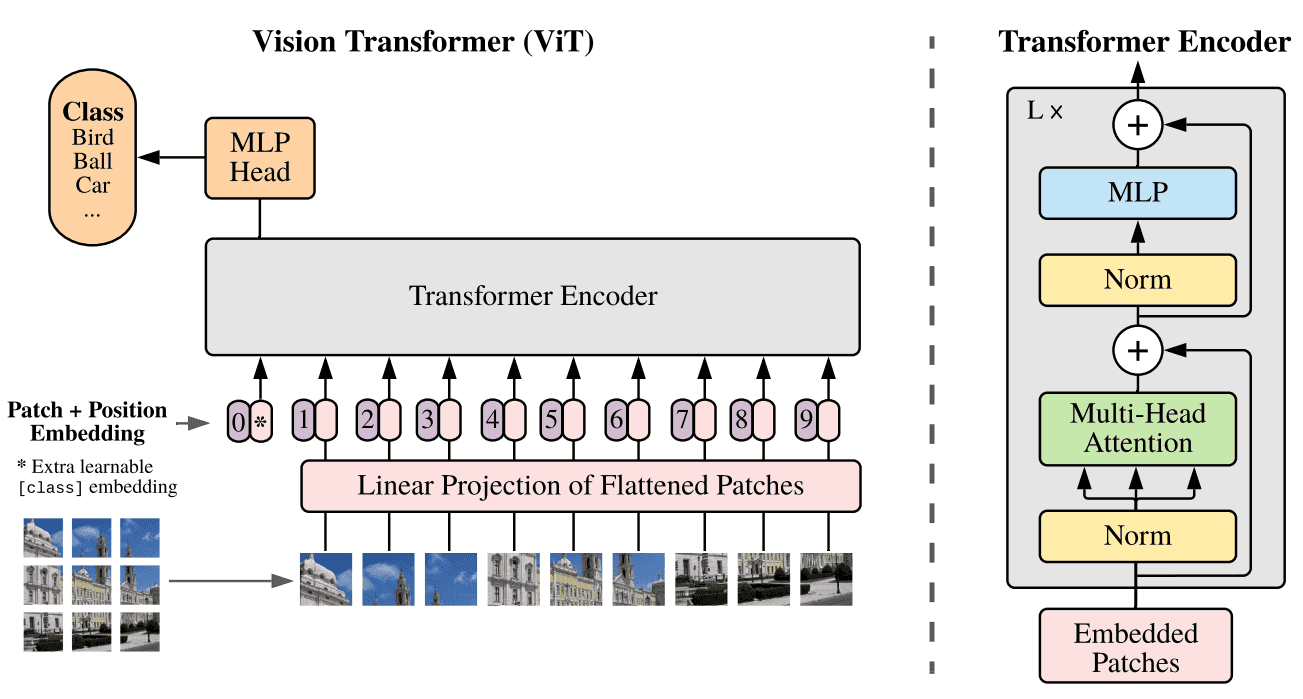

极智AI | 详解 ViT 算法实现

欢迎关注我,获取我的更多笔记分享 大家好,我是极智视界,本文详细介绍一下 ViT 算法的设计与实现,包括代码。 ViT 全称 Vision Transformer,是 transformer 在 CV 领域应用表现好的开始,而...

脑科学能用Transformer做什么?

图片来源@视觉中国 文 | 追问nextquestion 自ChatGPT问世以来,“Transformer模型”始终以超高频率出现在各个AI新产品模块当中。比如,大家所熟知的GPT-4、Midjourney、GitHub Copilot等,它们...

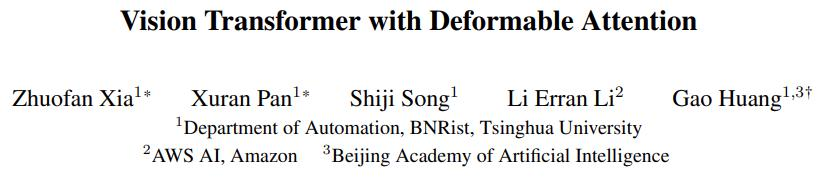

当Swin Transformer遇上DCN,清华可变形注意力模型优于多数ViT

机器之心报道 编辑:小舟 本文中,来自清华大学、AWS AI 和北京智源人工智能研究院的研究者提出了一种新型可变形自注意力模块,其中以数据相关的方式选择自注意力中键值对的位置,使得自注意力...

用 Vision Transformer 进行图像分类

Transformer 问世后被广泛地用在 NLP 的各种任务中,但是却很少出现在计算机视觉领域中。目前计算机视觉主流的模型依然是 CNN,各种 attention 操作也是在 CNN 结构上进行。本文介绍 Vision Tra...

Vision Transformer(ViT):打通CV与NLP领域的经典之作

打通的壁垒 回顾一下,在Transformer中,计算自注意力权重的时候,需要序列中的元素两两计算相似度(或者叫相容性函数),其计算复杂度是 O(n2)O( n^{2} )。所以,如果序列长度太长的话,计算复...