排序

调教LLaMA类模型没那么难,LoRA将模型微调缩减到几小时

作者:Sebastian Raschka 机器之心编译 编辑:赵阳 LoRA 微调方法,随着大模型的出现而走红。 最近几个月,ChatGPT 等一系列大语言模型(LLM)相继出现,随之而来的是算力紧缺日益严重。虽然人...

快收藏!23个优秀的机器学习训练公共数据集

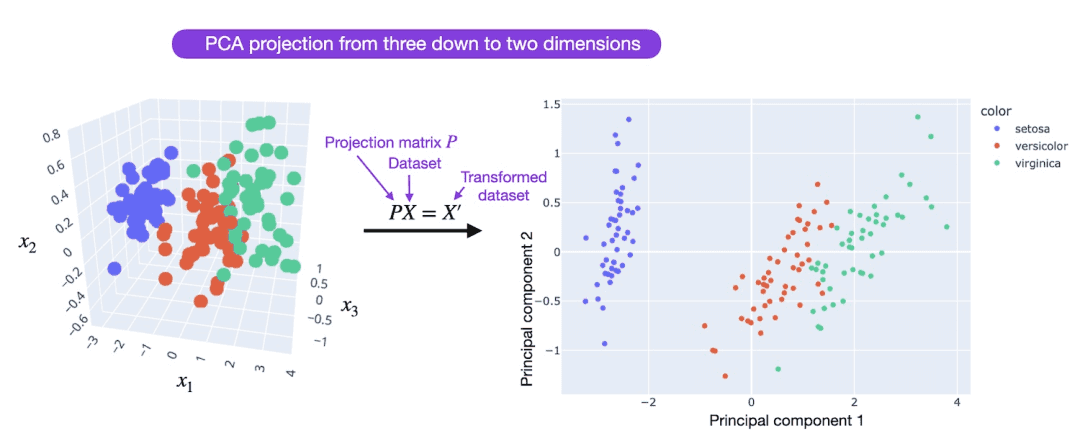

原文:23个优秀的机器学习数据集欢迎关注 @机器学习社区 ,分享更多机器学习、人工智能、深度学习、Python技巧Iris 数据集的那些示例你是不是已经用腻了呢?不要误会我的意思,Iris 数据集作为...

除了OpenAI,全球还有这12家生成式AI独角兽值得关注

作者丨巴里 编辑丨及轶嵘 图源丨图虫创意 2023年第一季度,全球科技行业不少公司因资金短缺陷入困境,出现了一波大规模的裁员潮。据统计,1-3月期间,全球科技企业共裁员超过10万人,这一数字已...

小白学AI – YOLOv8目标检测 – 训练自己的数据集(Windows环境)

mac环境训练自己的数据集,这训练时间可闹心了,500张素材,训练400轮,训练了12个小时,才训练100轮,这时间真真是太久了,所以找一台闲置的Windows电脑试试,。弄完发现跟电脑没关系,跟cpu,...

用900万数据集训练!人工智能提高癌症预测率【附癌症早筛市场预测】

原标题:用900万数据集训练!人工智能提高癌症预测率【附癌症早筛市场预测】 胰腺癌是世界上最致命的癌症之一,每年大约有44000人确诊,死亡人数达到38000人。因为胰腺位于腹部深处,检测起来困...

谷歌发布最大语言模型:等于9个GPT-3,训练成本却低得多

杨净 发自 凹非寺量子位 报道 | 公众号 QbitAI今天,谷歌大脑声称,他们新技术能训练万亿级参数的语言模型。 万亿级,什么概念? 烧了微软10000张显卡的GPT-3,也不过1750亿参数。 现在,他们将...