排序

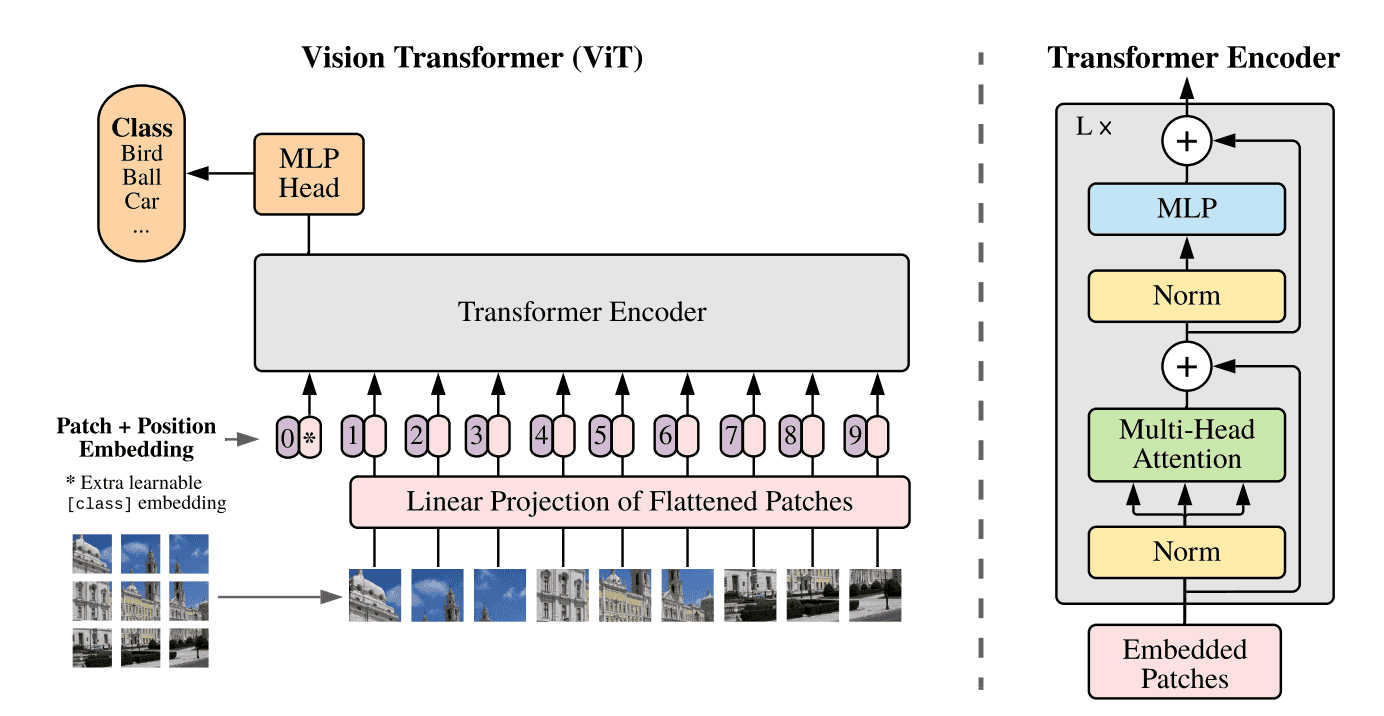

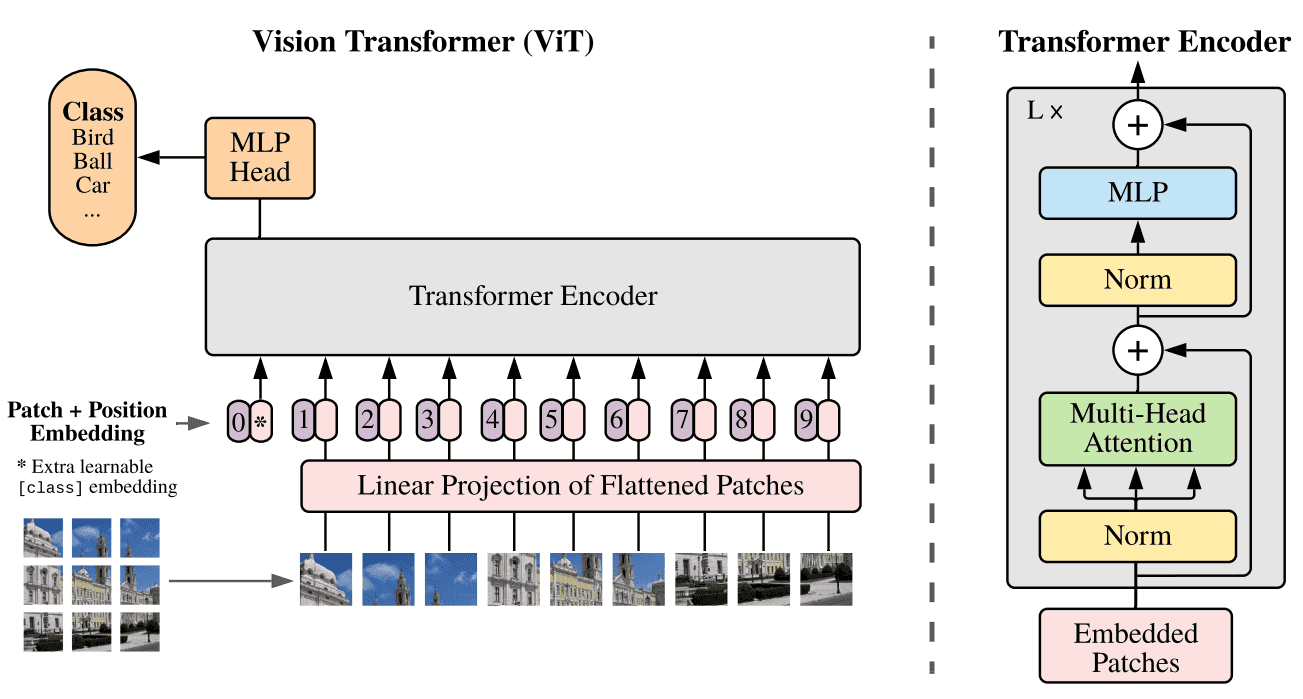

ViT-Vision Transformer 详解

Hello 小伙伴们大家好,最近在做多模态的工作,然后发现现在NLP和CV的预训练模型结构逐渐趋同,可以说是transformer占据了半壁江山,为了让大家更好的了解这些模型的结构以及实现方法,所以我打...

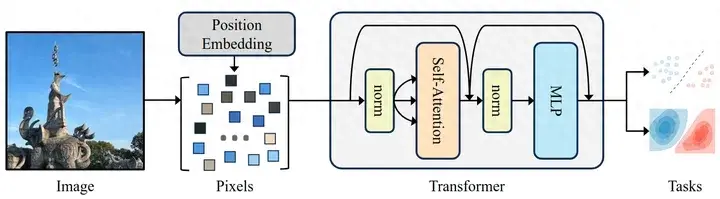

局部归纳偏置真的有必要吗?探索 Transformer 新范式!

作者丨科技猛兽 编辑丨极市平台 本文目录 1 一个像素就是一个 token!探索 Transformer 新范式 (来自 FAIR, Meta AI,阿姆斯特丹大学) 1 PiT 论文解读 1.1 局部性这个归纳偏置可以在 Transforme...

用 Vision Transformer 进行图像分类

Transformer 问世后被广泛地用在 NLP 的各种任务中,但是却很少出现在计算机视觉领域中。目前计算机视觉主流的模型依然是 CNN,各种 attention 操作也是在 CNN 结构上进行。本文介绍 Vision Tra...

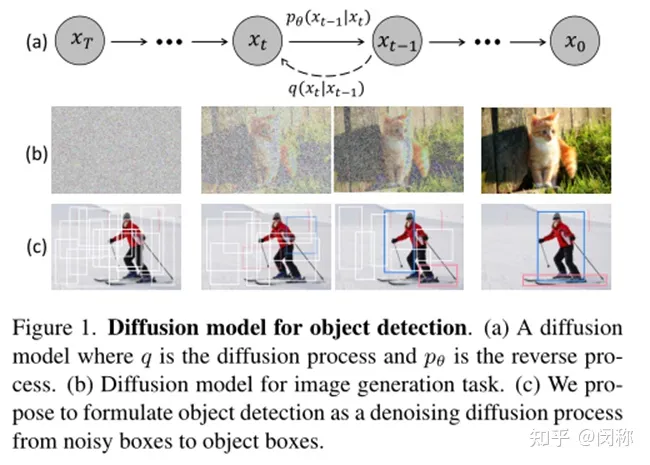

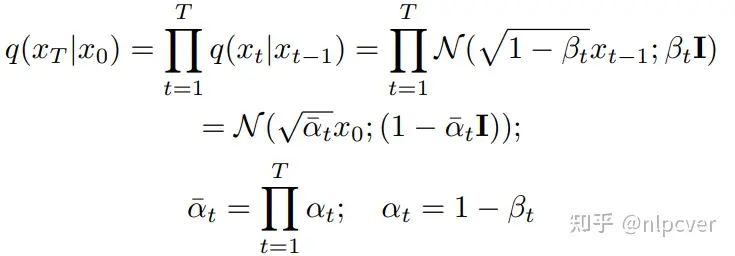

DiffusionDet:基于扩散模型的目标检测框架

扩散模型在生成任务上非常成功,自然就想到将其扩展到其他任务上,果然香港大学的罗平团队就出了这个DiffusionDet。后续是不是可以将其扩展到各种任务上。Denoising Diffusion is all you need...

六、Vision Transformer(ViT)

辰流看完Transformer之后,梦里都是Attention。 谢谢你,nlp。 谢谢你,attention。 谢谢你,transformer。 感谢多了,或许就要流泪了。 俗话说趁热打铁。第五章中的Transformer虽用于nlp领域,...

Scalable Diffusion Models with Transformers(DiTs)论文阅读 — 文生视频Sora模型基础结构DiT

文章地址:Scalable Diffusion Models with Transformers 简介 文章提出使用Transformers替换扩散模型中U-Net主干网络,分析发现,这种Diffusion Transformers(DiTs)不仅速度更快(更高的Gflo...