排序

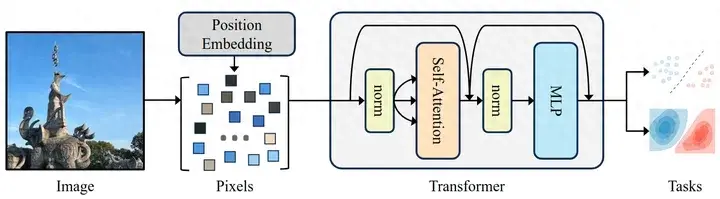

局部归纳偏置真的有必要吗?探索 Transformer 新范式!

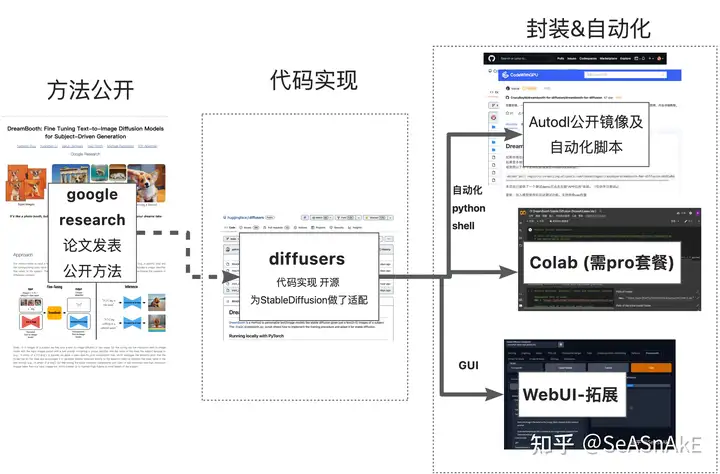

作者丨科技猛兽 编辑丨极市平台 本文目录 1 一个像素就是一个 token!探索 Transformer 新范式 (来自 FAIR, Meta AI,阿姆斯特丹大学) 1 PiT 论文解读 1.1 局部性这个归纳偏置可以在 Transforme...

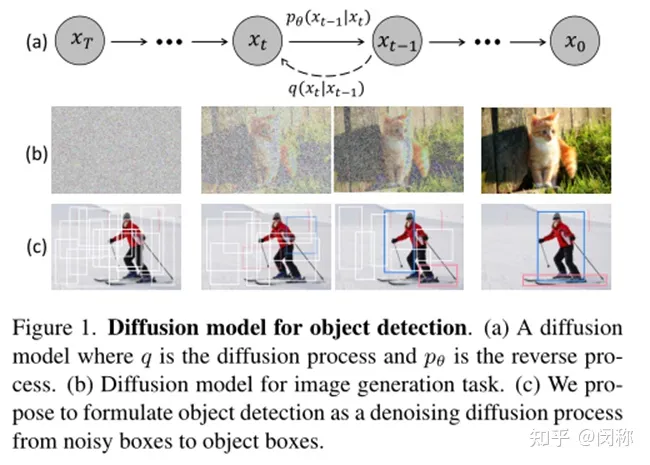

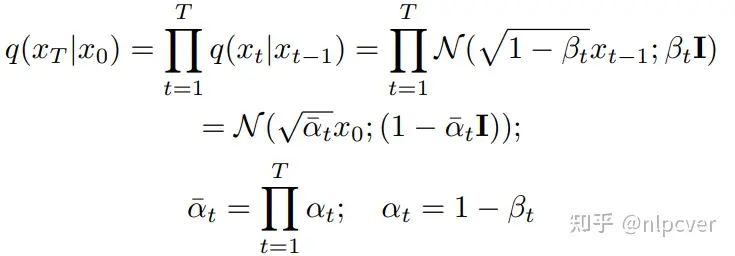

DiffusionDet:基于扩散模型的目标检测框架

扩散模型在生成任务上非常成功,自然就想到将其扩展到其他任务上,果然香港大学的罗平团队就出了这个DiffusionDet。后续是不是可以将其扩展到各种任务上。Denoising Diffusion is all you need...

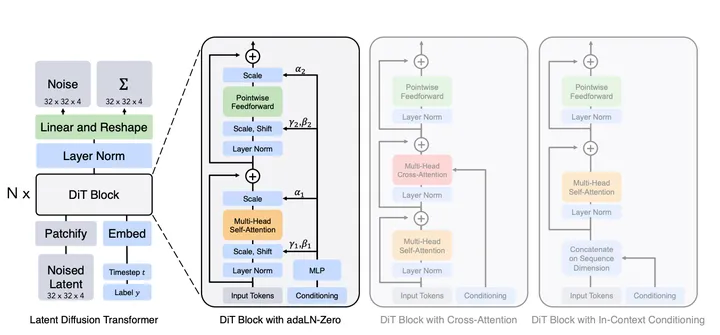

Scalable Diffusion Models with Transformers(DiTs)论文阅读 — 文生视频Sora模型基础结构DiT

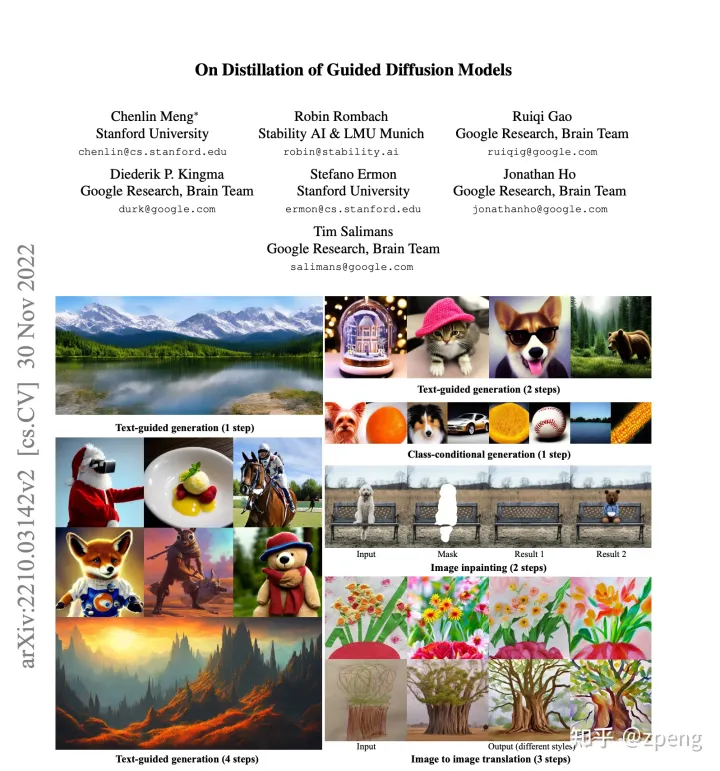

文章地址:Scalable Diffusion Models with Transformers 简介 文章提出使用Transformers替换扩散模型中U-Net主干网络,分析发现,这种Diffusion Transformers(DiTs)不仅速度更快(更高的Gflo...

DiT:Transformers 与扩散模型强强联手

出品人:Towhee 技术团队 王翔宇、顾梦佳(@JJJael) 扩散模型在图像生成领域有着难以撼动的地位,而其通常都选择了卷积 U-Net 作为主干模型,那么在其他领域大杀四方的 Transformers 在扩散模...

统治扩散模型的U-Net要被取代了,谢赛宁等引入Transformer提出DiT

来自 UC 伯克利的 William Peebles 以及纽约大学的谢赛宁撰文揭秘扩散模型中架构选择的意义,并为未来的生成模型研究提供经验基线。机器之心报道,编辑:陈萍、蛋酱。 近几年,在 Transformer ...

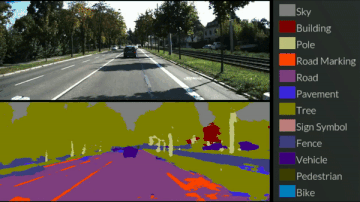

一文带你读懂 SegNet(语义分割)

本文为 AI 研习社编译的技术博客,原标题 : Review: SegNet (Semantic S 本文为 AI 研习社编译的技术博客,原标题 : Review: SegNet (Semantic Segmentation) 作者 |SH Tsang 翻译 |斯蒂芬•...