点击下方卡片,关注“FightingCV”公众号

回复“AI”即可获得超100G人工智能的教程

点击进入→FightingCV交流群

仅作学术分享,不代表本公众号立场,侵权联系删除

转载于:机器之心

生成内容一直被视为 AI 领域中最具有挑战性的能力,最近大火的 AI 绘画背后,是 Stable Diffusion 模型的开源,催生了众多 AI 绘画的应用,得益于 Stability AI 的开源精神,这一创变推动了整个以英文为主的下游文生图生态的蓬勃发展。

然而在国内,目前大部分团队主要是基于翻译 API + 英文 stable diffusion 模型进行开发,但由于中英文之间所得存在文化差异导致遇到中文独特的叙事和表达时,这种模型就很难给出正确匹配的图片内容。因此,IDEA 研究院认知计算与自然语言研究中心(IDEA CCNL)开源了第一个中文版本的 stable diffusion 模型“太乙 Stable Diffusion”,让中文的世界真正拥有具备中国文化内核的 AIGC 模型。

太乙 Stable Diffusion 纯中文版本:https://huggingface.co/IDEA-CCNL/Taiyi-Stable-Diffusion-1B-Chinese-v0.1

太乙 Stable Diffusion 中英双语版本:https://huggingface.co/IDEA-CCNL/Taiyi-Stable-Diffusion-1B-Chinese-EN-v0.1

中文运笔,意境浮现

君不见黄河之水天上来 ,唯美,油画

滔滔江水,连绵不绝 ,唯美,插画

飞流直下三千尺 ,唯美,插画

长城,清晨,朦胧,唯美,插画

梦回江南,中国古代小镇,唯美,插画

云南苗家古寨,原始森林,鸟语花香,唯美,插画

中国的未来城市,科幻插画

中文 vs 英文的图片生成

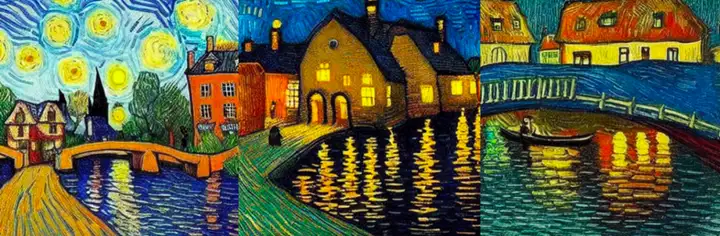

中文指导的特定风格生成

小桥流水人家,水彩

(Taiyi-Stable-Diffusion-1B-Chinese-EN-v0.1)

小桥流水人家,Van Gogh style

(Taiyi-Stable-Diffusion-1B-Chinese-EN-v0.1)

太乙系列文本生成图像模型技术揭秘

第一个开源中文 CLIP 模型

2022 年 7 月,IDEA CCNL开源了第一个中文 CLIP 模型,目前已经有 4 个版本。

Taiyi-CLIP-Roberta-102M-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-Roberta-102M-Chinese

Taiyi-CLIP-Roberta-large-326M-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-Roberta-large-326M-Chinese

Taiyi-CLIP-RoBERTa-102M-ViT-L-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-RoBERTa-102M-ViT-L-Chinese

Taiyi-CLIP-RoBERTa-326M-ViT-H-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-RoBERTa-326M-ViT-H-Chinese

以 Taiyi-CLIP-Roberta-large-326M-Chinese 为例,IDEA CCNL用中文语言模型替换了开源的英文 CLIP 中语言编码器,在训练过程中冻结了视觉编码器并且只微调这个中文语言模型,在 1 亿级别的中文数据上训练了 24 个 epoch,一共过了约 30 亿中文图文数据,得到了这个包含图片信息的中文表征语言模型,为后续训练中文 Diffusion 相关的模型奠定了重要的基础。

第一个开源中文 Disco Diffusion 模型

2022 年 10 月,IDEA CCNL开源了第一个中文 Disco Diffusion 模型 Taiyi-Diffusion-532M-Nature-Chinese,该模型由 Katherine Crowsons 的无条件扩散模型在自然风景图上微调而来。结合 Taiyi-CLIP-Roberta-large-326M-Chinese 可以实现中文生成各种风格的风景图片。

东临碣石,以观沧海,水何澹澹,山岛竦峙:

第一个开源中文 Stable Diffusion 的模型

2022 年 11 月,IDEA CCNL开源了第一个中文 Stable Diffusion 的模型和中英双语 Stable Diffusion 模型。

太乙 Stable Diffusion 纯中文版本(Taiyi-Stable-Diffusion-1B-Chinese-v0.1)

该模型利用已经开源的太乙 CLIP 模型 (Taiyi-CLIP-RoBERTa-102M-ViT-L-Chinese) 替换了英文 stable-diffusion-v1-4 中的语言编码器,因为太乙 CLIP 模型已经具备了很强的中文图文概念,所以直接冻结英文 stable diffusion 的生成模型部分,在亿级别的高质量数据上微调语言编码器,调整学习率等超参数,将太乙 CLIP 模型理解的中文图文概念与 stable diffusion 生成能力对齐。

太乙 Stable Diffusion 中英双语版本(Taiyi-Stable-Diffusion-1B-Chinese-EN-v0.1)

不同于太乙 Stable Diffusion 纯中文版本,这个模型希望在支持中文的情况下,同时能保留 stable-diffusion-v1-4 的英文生成能力。由于 stable-diffusion-v1-4 原有语言模型不具备太乙 CLIP 模型强大的中文图文概念,IDEA CCNL希望在它的基础上增加了中文数据训练,这里采取了两阶段的训练。第一阶段也是冻住 stable-diffusion-v1-4 的生成模型部分,在亿级别的高质量数据上微调语言编码器,调整学习率等超参数,训练语言模型中文部分的表征。第二阶段放开 stable-diffusion-v1-4 的生成模型部分,增强中文引导图片生成的能力,目前训练中的一个 checkpoint 已取得不错的效果并进行了开源。

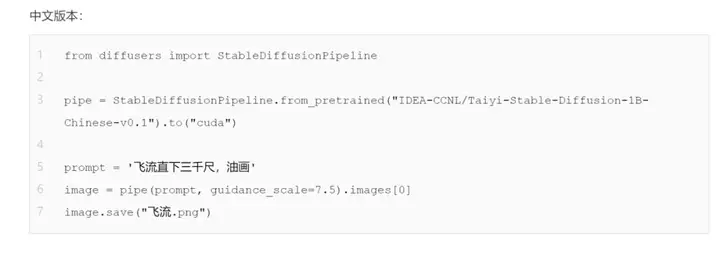

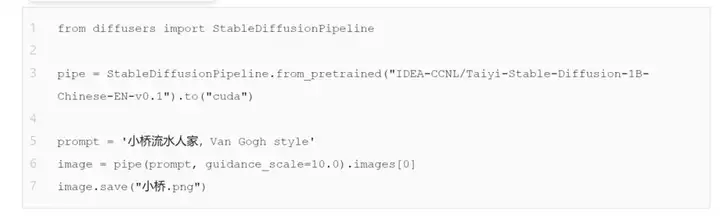

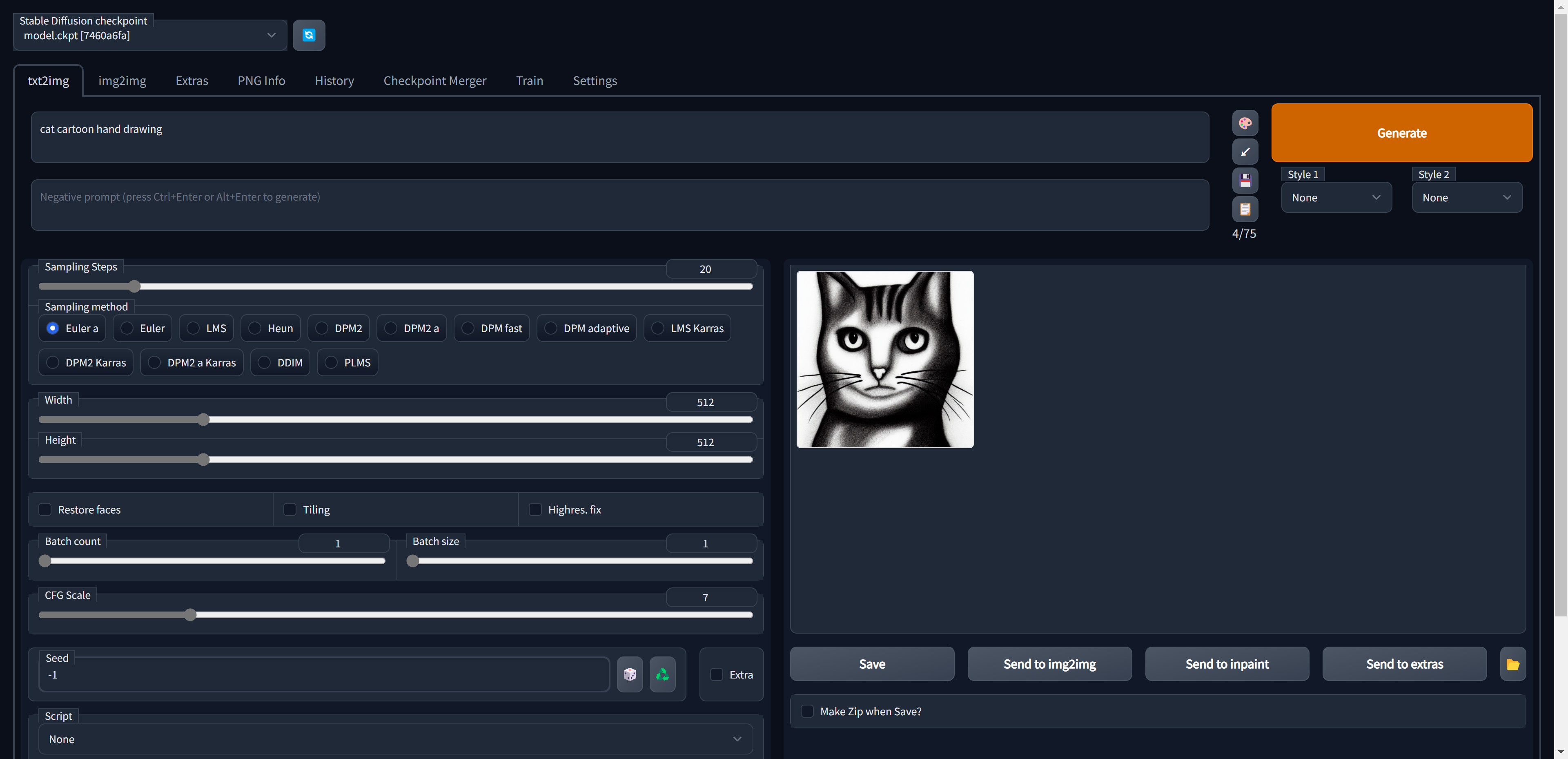

使用方法

如果需要进行古诗场景、中文概念生成,建议尝试中文版本 Taiyi-Stable-Diffusion-1B-Chinese-v0.1。如果需要一些通用场景和概念的生成,尤其是有中文混合英文需要,建议尝试中英双语版本 Taiyi-Stable-Diffusion-1B-Chinese-EN-v0.1。

中文版本:

中英双语版本:

太乙 – 中文 Stable Diffusion 的未来

目前在庞大的中国市场中,有将近 10 亿的文化产业正在被 AIGC 冲击并快速创新发展,也有更多的新机遇在裂变中产生。由于此前的 AIGC 模型还无法和特殊的中国文化背景相结合,致力于成为中文认知智能的基础设施的 IDEA 研究院认知计算与自然语言中心,希望通过推出太乙模型,助力加快在 AIGC 全球市场化中中国的文化产业数字化转型的创新发展,促进各个相关行业的升级。而太乙所在的封神榜预训练模型开源体系,已经开源 80 个模型,覆盖 AIGC、自然语言理解、受控文本生成等多个领域,成为中文最大的预训练模型开源体系。基于封神榜模型的 GTS 模型生产平台,自动生产的 1 亿参数模型,击败众多百亿千亿参数模型,进入 FewCLUE 榜单前三名,机器自动化生成模型的能力达到了算法专家水平,AI 生产 AI 的时代正在到来。

IDEA CCNL认为,在 AIGC 中,人的作用是更为重要的,生成式 AI 应悄无声息地融入大众生活中并更好地帮助拓展人类的想象力边界。所以,与 AI 互动生产的内容,是帮助AIGC走向下一个生产力阶段的关键。因此,IDEA CCNL除了基础模型和基础算法的研究之外,还在研究更精准的文本生成和基中文于文本的交互式图片编辑。以太乙为核心的 AIGC 模型会持续更新和升级,敬请期待。

欢迎对太乙感兴趣的小伙伴们联系IDEA CCNL,一起共建中文 AIGC 的新世界。

封神榜相关链接:

封神榜总论文(中英双语):https://arxiv.org/abs/2209.02970

封神榜主页:https://github.com/IDEA-CCNL/Fengshenbang-LM(封神榜大模型)是 IDEA 研究院认知计算与自然语言研究中心主导的大模型开源体系,成为中文认知智能的基础设施。

huggingface 地址:https://huggingface.co/IDEA-CCNL

封神榜 doc: https://fengshenbang-doc.readthedocs.io/zh/latest/

往期回顾

基础知识

【CV知识点汇总与解析】|损失函数篇

【CV知识点汇总与解析】|激活函数篇

【CV知识点汇总与解析】| optimizer和学习率篇

【CV知识点汇总与解析】| 正则化篇

【CV知识点汇总与解析】| 参数初始化篇

【CV知识点汇总与解析】| 卷积和池化篇 (超多图警告)

最新论文解析

如何训练用于图像检索的Vision Transformer?Facebook研究员解决了这个问题!

ICLR22 Workshop | 用两个模型解决一个任务,意大利学者提出维基百科上的高效检索模型

See Finer, See More!腾讯&上交提出IVT,越看越精细,进行精细全面的跨模态对比!

MM2022|兼具低级和高级表征,百度提出利用显式高级语义增强视频文本检索

MM2022 | 用StyleGAN进行数据增强,真的太好用了

MM2022 | 在特征空间中的多模态数据增强方法

ECCV2022|港中文MM Lab证明Frozen的CLIP 模型是高效视频学习者

ECCV2022|只能11%的参数就能优于Swin,微软提出快速预训练蒸馏方法TinyViT

CVPR2022|比VinVL快一万倍!人大提出交互协同的双流视觉语言预训练模型COTS,又快又好!

CVPR2022 Oral|通过多尺度token聚合分流自注意力,代码已开源

CVPR Oral | 谷歌&斯坦福(李飞飞组)提出TIRG,用组合的文本和图像来进行图像检索

暂无评论内容