01

高岭土的破解

中国的瓷器工业曾经遥遥领先世界,通过向欧洲出口赚取高额利润。差不多统治市场长达上千年,而其中的秘诀,就是高端瓷器使用了景德镇的高岭土。

法国传教士殷弘绪1699年来到中国。他一边传教一边学习陶瓷制作工艺,获取了景德镇陶瓷制作工艺的第一手资料。同时为了验证这些资料的准确性,他查阅了不少陶瓷典籍,尤其是景德镇当地文献。

殷弘绪将这些资料成果整理成两封书信,分别于1712年9月1日和1722年1月25日发给奥里神父。

在信中,他写道:

“制瓷原料是由叫做白不子和高岭的两种土合成的……精瓷之所以密实, 完全是因为含有高岭土。高岭土可比作瓷器的神经……”

这两封书信传到法国50年后,法国陶工终于在利摩日找到了高岭土,并成功生产出硬质瓷。当然了,法国人还发现高岭土中,有一类可以治疗腹泻,发明了“蒙脱石散”,这是后话… …

随着高岭土配方的破解,中国的瓷器技术被欧洲学习并超越,市场占有率一落千丈。

02

不要一提开源就跳脚

星空君是推崇开源的,中国的码农也是全球开源大军中重要的组成力量,为世界开源事业做出了伟大的贡献。

很多人经常把一句话挂在嘴边:一开源就有国产。暗示所谓国产都是模(chao)仿(xi)。

其实中国并不是一开始就强调什么都要国产的,尤其是上世纪90年代加入WTO前后,中国一直试图融入全球产业链,成为合理的一个环节。

注意,是合理。

如果欧美当一等人,日韩当二等人,中国和亚非拉人只能当三等甚至末等人,永远8亿衬衫换一架波音,那么这个产业链一定是不合理的。

2010年4月15日,美国总统奥巴马在白宫接受澳大利亚电视台采访时说,“如果超过10亿中国人的生活方式与澳大利亚人和美国人现在的生活方式相同,那么我们所有人都将处于一个非常悲惨的时期。”

很显然,有些人不想拿中国人当人。或者,他们想当中国人的人上人。

在这种情况下,利用拿来主义模(chao)仿(xi)开源产品做成国产自主可控产品,星空君觉得并没有什么道德上的负担。

一个冷知识,现在中国的国产操作系统、软件,绝大多数都符合开源协议(麒麟操作系统曾经有过被反编译发现抄袭的黑历史,但后来也通过符合开源协议和解)。

哪怕被网友黑的体无完肤的鸿蒙,也是符合开源协议的。

有人想把你打回农耕文明,你还在冷嘲热讽备战备荒的行为不符合西方礼仪。

03

Stable Diffusion本地部署

文心一言刚放开测试的时候,其AI绘画功能被很多人嘲讽套了一个壳,后面接的是Stable Diffusion等开源产品。

先不说百度本身就是开源的积极践行者(当年连AI自动驾驶项目都开源了),这种全球级的大厂如果用这种方式,必然会被同行挖出,然后体无完肤。

百度只是商业营销方面有过道德瑕疵,软件开发方面还真没有。

星空君差不多用了两个礼拜深度使用Stable Diffusion,测试了数十个模型(含lora),安装了若干个插件(包括百度翻译prompt)… …

是因为好玩吗?

不,AI小姐姐的诱惑力还没那么大。

是因为它是先进生产力的发展要求,是先进文化的前进方向。

一定要为我所用。

1、什么是Stable Diffusion

现在在最火的AI绘图工具莫过于midjourney,已经可以生成近乎可以直接用来商用的AI图片。

不过,midjourney有两个门槛,一个是有些操作需要科学上网,第二个是每月有一笔不大不小的费用(30美金)。

如果不是以绘图为职业,仅仅是兴趣爱好,或者相对AI绘图有一个相对较为底层的了解,或许有另外的不花钱的选择。

Stable diffusion。

Stable diffusion是一个基于Latent Diffusion Models(潜在扩散模型,LDMs)的由文字生成图像的(text-to-image)模型。

重要的是,它是开源+本地化部署的。

需要声明的是,免费的,往往是最贵的,因为要有折腾的成本。

假如你是一个需要接商单的职业画师,建议还是去花钱。

2、给小姐姐完整的一生(身):硬件

首先你要有一块还算可以的Nvidia显卡,20系30系都可以,当然了,如果上最新的40系,除了价格贵以外,还可能会有开车太快的眩晕感。

如果实在没有显卡,集显用户也不是不能操作,比如我曾经用笔记本的集显跑一个多钟头算AI小姐姐,同样的参数,在Nvidia 3060上只需要5秒。

在预算较低的情况下,3060是一个非常不错的选择,为了后续使用ChatGLM(但是仅仅是跑起来而已,后面还是要升级显卡),我特意选了12G显存的配置,内存16G,硬盘换成了长江存储颗粒的2T容量SSD。

最近长存颗粒杀红眼了,2T只需要500块。

本来看好了一套深度学习的主机,要2万块,但想了想不如先从起步开始。

3060的全套配置(不含显示器)下来,只需要6000块。

3、选择一个汉化好的安装包

Stable diffusion是开源的,已经有了不少的汉化的不错的版本。

如果你是老手,请点击右上角的关闭符号;

如果你是新手,本文会给你一个简单到“一键式”使用的操作方式。

下载:

https://pan.baidu.com/s/1aT9t7hwVjasaNboE6nK0ng?pwd=lgyh

(请复制到浏览器打开,提取码lgyh)

这个安装包整合了Stable diffusion依赖的所有环境,可以一键启动.

不过体积也比较大,差不多十几个G,如果想要获得很好的效果,还要下载安装一些模型,一般模型都要几个G,所以2T的硬盘是有必要的。

启动界面说明:

生成引擎是选择你要计算用的显卡,显存优化根据你的显卡实际容量进行选择,监听端口默认7860,这个端口可以修改,如果开放远程连接,则需要在系统的防火墙里进行配置,允许TCP协议通过7860(或修改后)的端口。

开放远程连接的好处是可以在其他电脑(局域网内)甚至手机上连接该电脑,进行AI绘图。这样我只需要把台式机塞在桌子底下,用核显笔记本连接进行绘图即可。

如果拥有公网地址,则可以通过路由器配置端口映射在互联网随时访问。

以win11为例,在防火墙和网络防护–高级设置–入站规则,增加一个规则“7860”,规则的内容为TCP协议允许7860特定端口被访问。

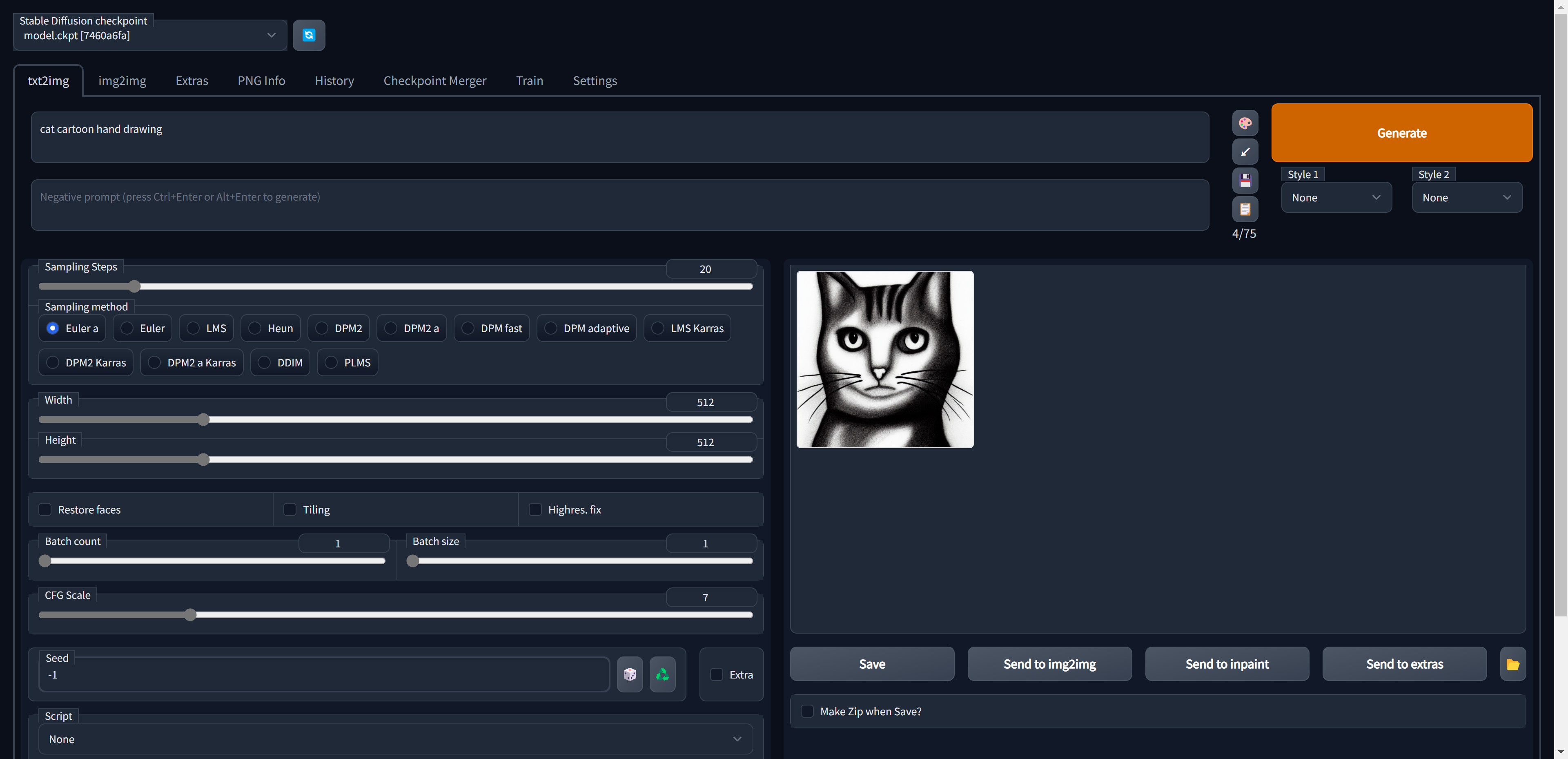

4、开始你的第一张AI小姐姐吧:常见功能介绍

程序启动成功后,系统会自动打开浏览器并跳转到绘图页面。

如果在局域网里其他电脑访问,可以采用 http://ip地址:7860 的方式。

最常用的是“文生图”功能,也就是用文字触发AI绘图,现在大部分版本只支持英文,这对使用者输入关键词的能力非常高。

也可以安装百度翻译的插件,能够相对轻松的实现和AI的交互。

第一批因为AI绘画下岗的画师,已经开始在网上批斗Stable Diffusion等AI工具了,但没有意义,与其抨击,不如拥抱未来。

04

开源版的ChatGPT

OpenAI的股权架构发生了比较大的变化,马斯克作为初始投资者之一,几乎没有任何控制权。

换言之,这成了一个资本操控的公司,背后最大的资本是微软。所以,指望ChatGPT开源,难度很大(当然不排除会开源一个低阶版本)。

在ChatGPT火爆的同时,清华团队推出的ChatGLM没有得到公众的重视。

但星空君重视了,因为它有两大特点,是ChatGPT不可能取代的。

一是仅需消费级显卡,单机可部署。ChatGLM对显卡最低配置要求才7G,当然了,如果很好的跑起来起码要13G(市面上没有这么巧合的显卡,你只能买16G起),再进一步想要自己训练的话,可能24G起步。虽然是消费级,但这是高消费啊!话又说回来,和OpenAI烧了十几万张专业算力卡相比,ChatGLM实在是太太太亲民了。

二是开源(ChatGLM做了两个版本,一个是130B的商业版,一个是开源的是6B版本)。开源的意思是全世界的爱好者都可以参与开发,众人拾柴火焰高。星空君想到的第一件事就是可以训练专属语料库,用在垂直领域。并且惊喜的发现,已经有人在这么干了,把开源代码放在了github.上。

然而看到显卡配置的时候,星空君眼前一黑。

截至目前(4月9日),ChatGLM共有三个图形界面部署包,一个是秋叶大神(B站ID:秋葉aaaki,Stable diffusion的中文一键部署包就是他的杰作)制作的,一个是大江户战士制作的,另一个是官方团队制作的。

略搞笑的是,其中做的体验最差的是官方团队那一版。

本文推荐秋叶大神的版本(为了鼓励作者,请到他的主页三连:笔芯)。

链接: https://pan.baidu.com/s/1LlhQTHrMpI8kUPI6-dkP6Q 提取码: 31j8

1、准备工作

第一依然是显卡,8G起步,6G的不要考虑了,12G也只能玩缩水版,16G可以给她完整的一生,如果要训练自己的语料库,24G的显卡是必须的。

2、安装最新版的显卡驱动

3、安装最新版的cuda

Cuda是Nvidia的专属工具,新版可以对显卡的算力进行优化。在部署Stable diffusion的时候没有发现问题,但在部署ChatGLM的时候却发现报错,升级cuda后解决。

4、一键启动后的界面

目前ChatGLM的功能相对单一,语料库不是特别充分。

和ChatGPT相比,跑在本地的ChatGLM还比较弱小,但,星星之火可以燎原。

开源,意味着无限可能。

05

国产AI产业链

事实上,中国的AI产业是全球第二,远超第三。

百度推出文心一言后,阿里的通义千问也开始上线,华为、腾讯等大厂即将推出自己的大模型。

大模型是AI时代的大基建,是大厂们的角斗场,对于中小企业来说,选择好的赛道深化应用才是明智之举。

比如科大讯飞在语音方面的应用,依托于大模型就会很有想象力。讯飞已经能很好的进行中外语言的文本化转换了,和大模型一结合,分分钟生成专业的外文文档(论文党看哭了)。

比如同花顺在AI智能投顾方面造诣颇深,接入大模型后进行私有语料库的训练,可以把自然语言轻松地转化成同花顺的底层数据库所能理解的复杂公式,小学文化理解这些复杂的炒股指标不是梦。

再比如工业机器人领域,初看起来和ChatGPT、ChatGLM没什么关联,但是机器人的操作本质上是代码驱动的,如果利用AI让机器直接理解自然语言,那中间的调试过程大大减少,工业机器人的迭代速度很可能指数级上升。

你能想象,一个用自然语言和机器人交互的时代,是多么美好吗?

暂无评论内容