原标题:为何同一个中文大模型,不同评测标准打分差异大?|见智研究

5月9日中文通用大模型综合性评测基准SuperCLUE正式发布。经过一天时间的发酵,论坛上对该评测标准质疑的声音越发多了,这是为什么?大模型评测标准设立的难度又在哪里?

中文评测标准为何重要?

科大讯飞董事长刘庆峰认为:如果要努力追赶OpenAI的进度,需要一套科学系统的评测体系;用这一套科学系统,来判定技术迭代到底到了什么程度,还有哪些任务是不达标的。

市场看重中文大模型评测标准主要基于三方面考虑因素。

第一、数据集的差异性。中文和英文的文本数据集在种类、规模、质量等方面存在很大的差异,需要针对中文特点开发相应的数据集,以确保评测结果的准确性和公正性。

第二、语言结构和语法的差异。例如中文是一种“主谓宾”结构的语言,而英文则是“主语动词宾语”结构的语言。这些差异导致了中英文之间在语言处理任务上存在很大的区别,需要不同的评测标准和方法。

第三、中文词汇量和歧义性。中文的词汇量非常大,而且存在很多歧义性,需要更复杂的处理方法和技术,如分词、词性标注、命名实体识别等。

华尔街见闻·见智研究认为:中文大模型评测标准的重要性在于它可以帮助厂商相对客观地评估模型的质量和性能,比较不同模型的性能和差异。更重要的是标准化的评估方法和数据集能够为开发者提供很好的方向,促进模型迭代速度。

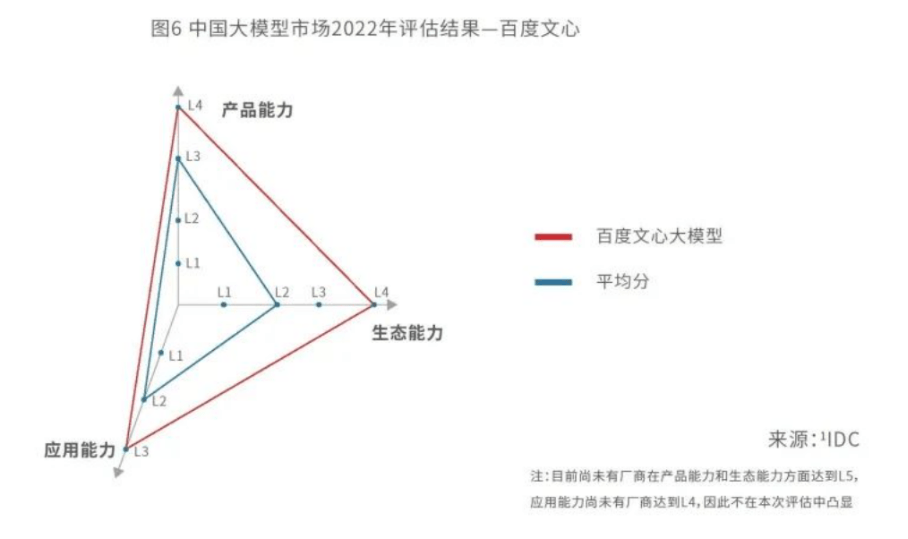

此前,IDC发布的大模型评测标准,从三个维度(产品能力、应用能力和生态能力)、6个一级指标和11个二级指标来评估中国大模型的能力。

并且给出结论:文心大模型在产品力和生态能力上都超过平均分水平。但是由于评测方法没有完全公开,貌似并没有被市场所完全认可。

所以,在大模型层出不穷的当下,市场上非常需要对模型的评估方法和一致性标准。

但从当下来看,这貌似又是一个在短期内非常难以兑现的预期。

中文大模型评测标准化很难,SuperCLUE被吐槽选择题方式单一

刚刚发布的文通用大模型基准(SuperCLUE),是针对中文可用的通用大模型的一个测评基准。它主要回答的问题是:在当前通用大模型大力发展的情况下,中文大模型的效果情况。

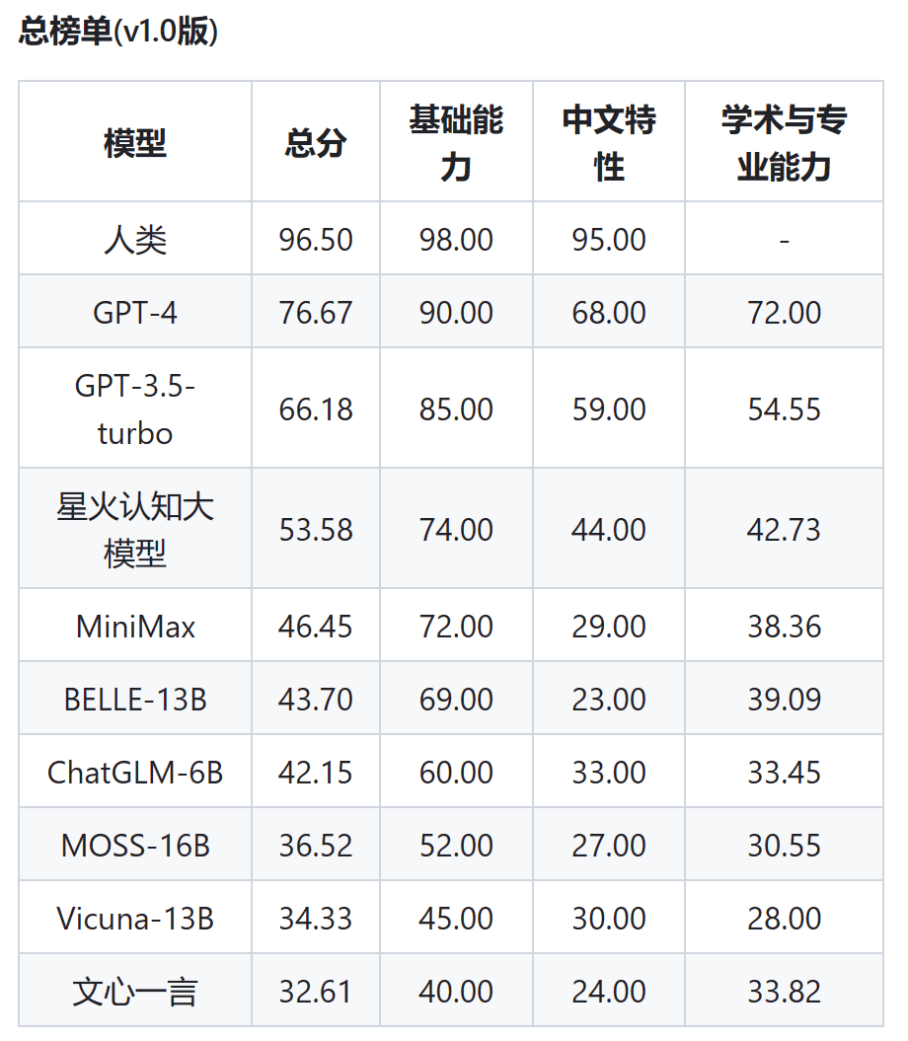

SuperCLUE从三个不同的维度评价模型的能力:基础能力、专业能力和中文特性能力。

基础能力:包括了常见的有代表性的模型能力,如语义理解、对话、逻辑推理、角色模拟、代码、生成与创作等10项能力。

专业能力:包括了中学、大学与专业考试,涵盖了从数学、物理、地理到社会科学等50多项能力。

中文特性能力:针对有中文特点的任务,包括了中文成语、诗歌、文学、字形等10项多种能力。

以SuperCLUE测试结果来看,文心一言的评测结果远不如星火大模型;

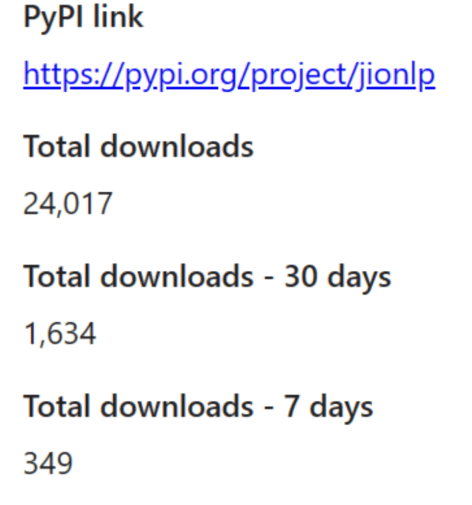

而以另一种比较火的评测标准是JioNLP,该评测是由中国科学院计算技术研究所自然语言处理与社会人文计算实验室(简称“计算所NLP”)开发和维护的。

JioNLP评测还提供了多种评测指标和计算工具,以帮助研究者和开发者客观地评估模型的性能和效果,并比较不同模型的优缺点和适用范围。

JioNLP评测方式目前的总下载量达到2.4万次,近三十天下载量为1634次。

通过JioNLP评测,研究者和开发者可以获取实时的评测结果和排名,以及相应的源代码和技术报告,为中文自然语言处理的研究和应用提供参考和支持。

从JioNLP评测的结果来看:文心一言的得分却又高于星火大模型。

这背后的原因是两种评测的方法的设置有很大的差异性。

SuperCLUE是只通过选择题对模型能力进行测试,而JioNLP采用的是客观选择题+主观题(生成题、翻译题和聊天题)进行测试。

但相同的是,在官网留言区对于两个测试标准都出现很多质疑声音。

如:对SuperCLUE评测方法如何限定测试题目数量,生成和创作类评测用选择题测试是否合理,以及建议SuperCLUE像中文Alpaca一样适度公开评测说明和标准。JioNLP也同样存在测试精度、样本量小等问题。

见智研究认为:当下对大模型的评估方法和指标还没有形成共识、更没有统一的标准出现,特别是对于不同场景和任务可能有不同的评价体系和需求出现。

常用的机器学习模型评估标准有7个比较重要的方向:

包括准确度(针对分类能力)、精确度和召回率(模型正确预测的内容占该样本的比例)、对抗攻击鲁棒性(模型在受到输入干扰时保持稳定的能力)、计算效率、均方误差、R方值以及数据隐私。

从当下来看,SuperCLUE的评测方式单一性确实存在一定的弊端,但是该模型采用的人工评价的精度也曾被市场认可确实在精度和灵活度上面高于系统的自动评价方法。

总的来说,大模型测试标准化是行业所需要的,但同样也是非常难实现的。返回搜狐,查看更多

责任编辑:

暂无评论内容