SAE是deepfacelab中最好最灵活的模型。通过合理的参数配置,你可以定制自己显卡的专属模型。

新版本更新了SAEHD,SAE的升级版。测试下来,收敛速度和效果要强于SAE。更新一下SAEHD的参数。

Enable autobackup? (y/n ?:help skip:n) :

–启用自动备份? (是/否?:帮助 跳过:n):

–自动备份模型,每小时备份一次。保留最近15个备份的数据。

–和中文补丁的自动备份功能重复,二选一。备份会占用比较大的空间,预留好磁盘。

Write preview history? (y/n ?:help skip:n):

–写预览历史记录?(是/否?:帮助 跳过:n):

–每10s生成一张预览图,写入到model文件夹下的history文件夹。

–图片很多,占用空间、影响系统速度,一般不需要。我只在做实验的时候开启。

Choose image for the preview history? (y/n skip:n) :

–选择图像作为预览历史记录?(是/否跳过:n):?

–选择之前的记录作为预览

–跳过,做实验才用。

Target iteration (skip:unlimited/default) :

–目标迭代次数限制(跳过:无限制):

–目标迭代次数达成,即停止训练。

–一般默认一直跑。

Batch_size (?:help skip:0) :

–Batch_size值(跳过:无限制):

–Bs大小的范围 – 意思是,一次有多少图像被发送到神经网络训练。默认情况下,选择较低的值。越大越好越慢越吃显存,根据自己显存大小调节。BS越大视频整体效果越好。

–模型后期需要大的bs帮助收敛,bs越大需要的显存越大。显存不够,开启优化模式可以用一部分内存替代显存。

Feed faces to network sorted by yaw? (y/n ?:help skip:n) :

–通过yaw分类将养成人脸发送到神经网络?(是/否 跳过:n):

–在yaw模式下,src人脸按照与dst相同的方向排序。我们的想法是yaw是合适的人脸训练。但是,它没有经过充分测试。它对src素材的多样性有要求。

–src素材大于dst素材,或者src素材比较丰富时候启用这个。

Flip faces randomly? (y/n ?:help skip:y) :

–随意翻转脸?(是/否:?帮助 跳过:y):

–所有脸部水平翻转,增加src输入样本。如果关闭换脸会更自然,但需要src覆盖所有旋转角度。样本少的时候打开此选项。

–src缺少、角度不全、炼丹启动。对结果要求比较高不要启用。

–新版本支持后期修改。

Src face scale modifier % ( -30…30, ?:help skip:0) :

–Src面部比例修改器%( – 30 … 30,:?帮助 跳过:0):

–缩放src人物脸部。如果src面部对比dst更宽并且变脸效果不好,那么稍微减少这个值是有意义的。

–选择后不可更改。

Resolution ( 64-256 ?:help skip:128) :

–分辨率(64-256:?帮助 跳过:128)

–更高分辨率 – 需要更多内存,更长的训练时间。您可以选择64到256的任何16的倍数值。分辨率越高,单张照片的合成效果越好。

–选择后不可更改。

Half, mid full, or full face? (h/mf/f, ?:help skip:f) :

–半脸、中脸还是全脸?(H / mf/f,:?帮助 跳过:f):

–面部的一半(只包含五官,没有脸颊)、比半脸大30%、全尺寸

–新版本增加了mf,比半脸多30%面积

–选择后不可更改。

Learn mask? (y/n, ?:help skip:y) :

–学习遮罩?(是/否,:?帮助 跳过:y):

–是否学习遮罩。

–新版本支持修改。

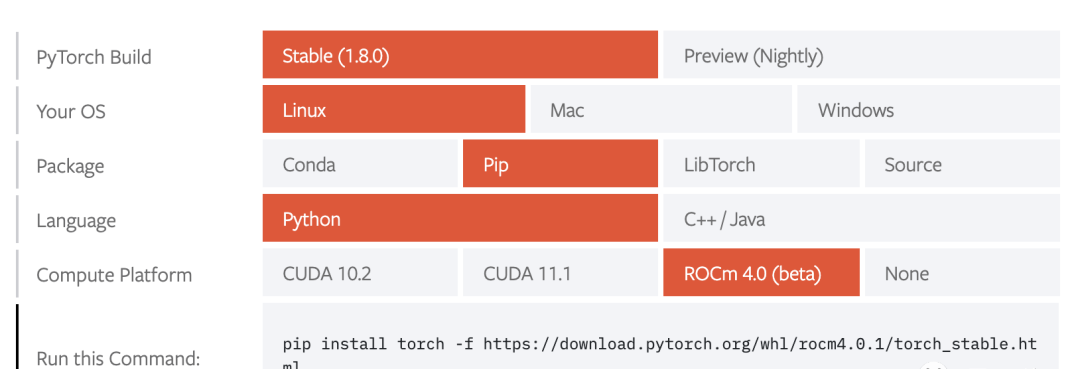

Optimizer mode? ( 1,2,3 ?:help skip:1) :

–优化模式?(1,2,3:?帮助 跳过:%d):

–此选项仅适用于NVIDIA显卡。优化模式神经网络。1 – 默认情况下。2 – 允许您的训练网络x2,需要更多系统内存。3 – 允许您训练网络x3更大,需要更多系统内存和最多30%的CPU资源。网络层越多,执行速度越慢。

–报OOM(显存溢出)的时候使用model 2、3可以缓解,单次迭代时间会增加。

AE architecture (df, liae ?:help skip:df) :

–AE架构(df,liae,vg:?帮助 跳过:df):

–神经网络的体系结构类型。

–选择后不可更改。

AutoEncoder dims (32-1024 ?:help skip:512) :

–编码器神经网络规模(32-1024?:帮助 跳过:512,liae-256):

–网络维度的数量,人物所有信息都将包含在这些方面。例如,如果这些维度不够,则人物闭上眼睛将无法被识别。维度越多越好,越吃显存。可以减少维度以达到您的显卡的要求。

–值小的话很多细微的表情会识别不到。

–选择后不可更改。

Enable random warp of samples? ( y/n, ?:help skip:y) :

–启用面部扭曲(y/n?:帮助 跳过:n):

–可以增加模型的融合性,训练一定程度后可以关闭这个选项,获得额外的清晰度。

Enable true face training? (y/n, ?:help skip:n) :

–启用true face 训练(y/n?:帮助 跳过:n):

–训练结果更像src,并增加额外的清晰度。在转换前启用它,并训练3w次。

–without trueface : https://i.imgur.com/MPPKWil.jpg

–with trueface +23k iters : https://i.imgur.com/dV5Ofo9.jpg

–可以参考上面的对比

Encoder/Decoder dims per channel (10-85 ?:help skip:21) :

–每个通道的解码器网络规模(10-85?:帮助 跳过:21):

–解码器的维数,有助于增加细节,越多越好,但会由于显存不足而无法启动。可以减少以达到您的显卡的要求。

–新版本解码编码器合为一个东西,新的21维度的解码器可以达到原来42的效果。

–选择后不可更改。

Use multiscale decoder? (y/n, ?:help skip:n) :

–使用多维度解码器?(是/否,?:帮助 跳过:n):

–是否使用多维度解码器?可以实现更高的清晰度。一般不用。

–这个没啥效果,新版本已删除。

Use CA weights? (y/n, ?:help skip: n ) :

–使用CA权重?(是/否,?:帮助 跳过:n):

–使用【Convolution Aware】权重初始化网络。这可能有助于实现更高精度的模型,但在首次运行时会消耗时间。

–会增加模型崩溃的概率。

–据说可以增加细节,初次初始化一般5-10分钟,后面不需要。我用8.30版本测下来没出现过崩溃,对品质有要求的可以选择y。

–新版本已经默认集成进去,不需要再设置。

Use pixel loss? (y/n, ?:help skip: n/default ) :

–使用像素丢失?(是/否,:?帮助 跳过:n /默认):

–它可以更轻松地改善细节并消除抖动。仅在20k次迭代后包含。

–会增加模型崩溃的概率,此步骤可以在训练后期更改。

–很容易崩溃,不建议开启,如果用的话搭配gradient clipping。

–新版本已经默认集成进去,不需要再设置。

Face style power ( 0.0 .. 100.0 ?:help skip:0.00) :

–学习人物风格,如光照和颜色(0.0 .. 100.0?:帮助 跳过:0.00):

–学习人物的风格,例如亮度和颜色。默认 0 – 不学

–会增加模型崩溃的概率,此步骤可以在训练后期更改。

–这个在模型训练完毕后,对模型进行备份。然后启用这个调节脸部颜色,需要变的颜色越多值越大,一般半小时到一小时就可以了。

Background style power ( 0.0 .. 100.0 ?:help skip:0.00) :

–学习人脸背景风格(0.0 .. 100.0?:帮助 跳过:0.00):

–学习脸部周围的背景的速度。在大多数情况下,用于适应dst中的人脸风格。默认 0 – 不教

–会增加模型崩溃的概率,此步骤可以在训练后期更改。

–这个在模型训练完毕后,对模型进行备份。然后启用这个调节脸部边缘的颜色,需要变的颜色越多值越大,一般半小时到一小时就可以了。

Apply random color transfer to src faceset? (y/n, ?:help skip:n) :

–使用随机颜色填充src图片,用来解决脸部颜色问题

–这个在模型训练完毕后,对模型进行备份。然后启用这个调节脸部颜色一般搭配facestyle使用,需要变的颜色越多值越大,一般半小时到一小时就可以了。

–新版本已经舍弃。

Color transfer mode apply to src faceset. ( none/rct/lct/mkl/idt, ?:help skip:False) :

–更改接近dst样本的src样本的颜色分布。尝试所有模式去找到最佳模式(可以参考合成的颜色调整经验)。老版本默认是lct,在一些数据集上表现并不好。

–后期可以修改。

Enable gradient clipping? (y/n, ?:help skip:%s) :

–开启后会降低模型崩溃的概率,但会牺牲训练速度。

–一般不开启,模型经常崩就开启这个。

Pretrain the model? (y/n, ?:help skip:n) : ?

–预训练模型?(是/否,?:帮助 跳过:n):?

–使用软件自带大量人脸数据集合(欧美的),通过预训练,增加模型的变能力。训练时间越长,效果越好。仅在第一次进入预训练,后面会跳过直接进入正常模式。预先训练模型的时间越长,变形能力越强。之后,会直接进入正常模式。

祝大家做出好的作品!

入门包会的视频教程,专人售后答疑?ai换脸教学公众号回复‘视频教程’了解。

暂无评论内容